Les quatre ruptures de l’intelligence artificielle

En mars 2018, un rapport sur l’intelligence artificielle en principe piloté par Cédric Villani mais visiblement « recadré » par France Stratégie est remis au premier ministre de l’époque . Cinq ans, après celui-ci a bien vieilli et on peut en conseiller la lecture tant il passe à côté des enjeux économiques, sociaux, environnementaux et cognitifs de l’IA. Voici un rapide tour d’horizon de ces enjeux, absents du rapport ou largement sous-estimés :

I/ Une rupture dans les conditions de diffusion d’une technologie nouvelle

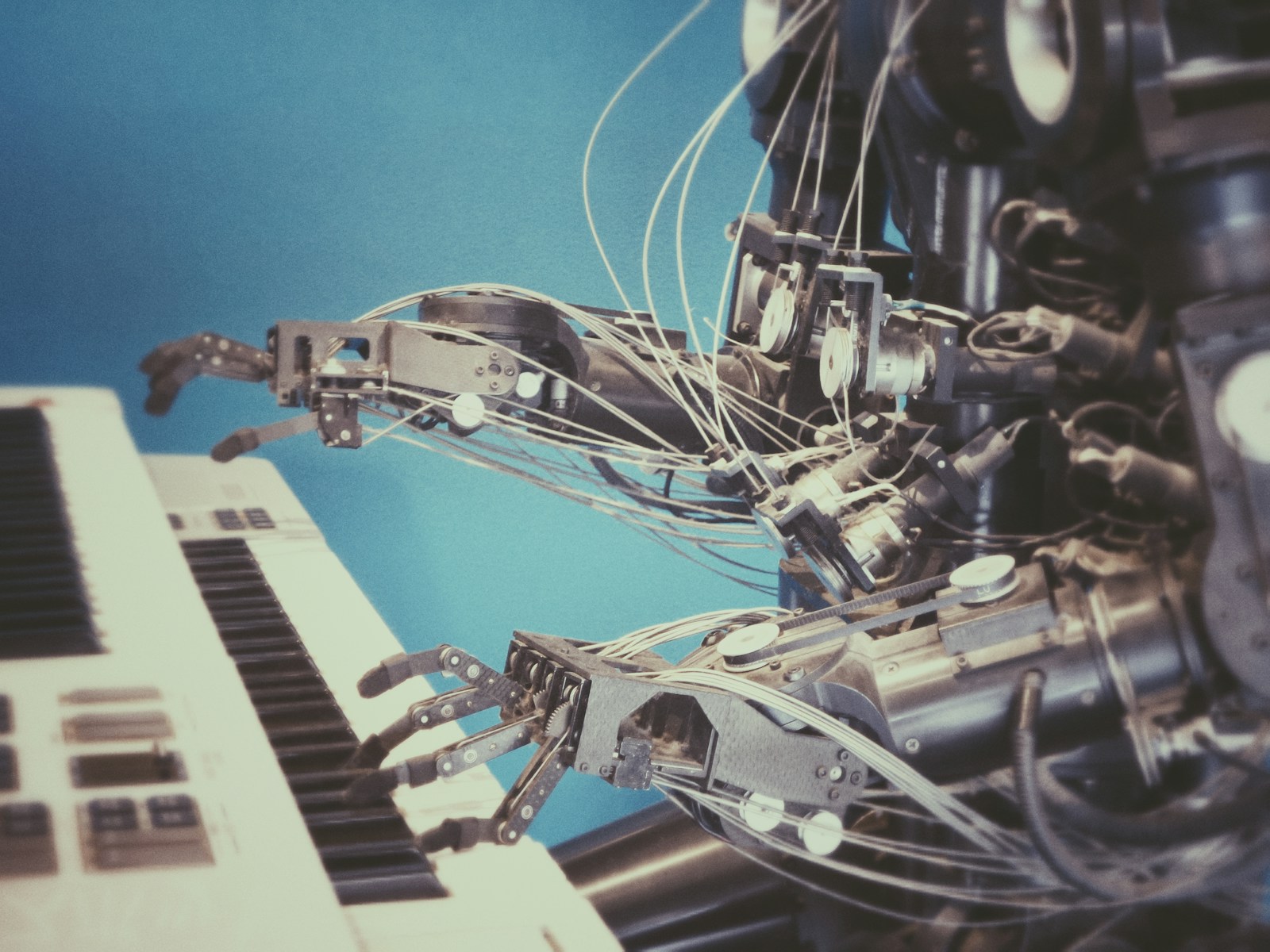

« Celui qui découvre une machine ou qui en fait le premier l’application pourra pendant quelques années jouir d’avantages spéciaux et légitimes et de profits énormes ». Deux siècles avant ce rapport sur l’IA, David Ricardo mettait en évidence une réalité qui semble sortie du champ des débats contemporains sur la diffusion de technologies nouvelles : Celles-ci sont pour l’essentiel développées puis mises en œuvre parce qu’elles permettent de générer un profit plus élevé, en volume ou en taux. L’IA doit s’analyser dans ce contexte, au-delà de la fascination pour les prouesses de l’IA générative, capable de générer à la demande des compilations de thèmes de toute nature, des images, musiques et vidéos, y compris des « deep fakes » (par exemple conception d’une fausse déclaration d’une personnalité publique ou politique afin de nourrir la propagande d’une sphère politique donnée).

La rupture dans la diffusion de cette technologie se situe à plusieurs niveaux :

• Les moyens financiers mobilisés sont gigantesques (plusieurs dizaines ou centaines de milliards d’euros) et s’appuient sur l’exploitation des centaines de milliards d’informations captées auprès des utilisateurs d’applications numériques (mobiles, tablettes, ordinateurs, équipements connectés, etc.). Il existe donc une barrière à l’entrée qui favorise la concentration de ces compétences dans les mains de quelques groupes mondiaux.

• Face à ces géants, les Etats sont d’autant moins armés pour réguler/encadrer les pratiques qu’ils se sont engagés depuis plus de trente ans dans un sabordage en règle de leurs capacités d’intervention, d’encadrement, de contrôle voire de sanctions.

• Ces technologies se développent de façon extrêmement rapide, leur rythme d’implantation n’a rien à voir avec le processus d’industrialisation ou de tertiarisation des économies, notamment occidentales.

Pour résumer, cette technologie particulière ne peut s’analyser à partir des critères lénifiants de la destruction créatrice chère à Schumpeter. Il s’agit d’une véritable rupture y compris dans ce domaine : plus rapide, plus concentré, plus cher, plus impactant, plus puissant face aux Etats.

II/ Une rupture qualitative et quantitative en matière d’emploi

La phase actuelle va beaucoup plus loin que la taylorisation des activités tertiaires. Elle va se traduire à la fois par une déqualification des emplois les plus qualifiés et par des pertes d’emploi : « Les cols blancs sont victimes de la dégradation du contenu de leurs tâches. La part cognitive de ces tâches est expropriée, systématisée sous forme de procédures abstraites, puis réinjectée dans le procès de travail pour être confiée à une nouvelle couche d’employés moins qualifiés que les professionnels qui les précédaient. C’est un raz de marée de déqualification en col blanc qui s’annonce. Depuis les scientifiques, mathématiciens et journalistes, jusqu’aux opérateurs de téléphonie, employés de magasins et secrétaire. On prévoit un bouleversement économique massif qui ne fait que commencer, qui affectera y compris les diplômés de l’université. C’est une révolution qui menace les architectes, mais pas les travailleurs de la construction ». Le CEPREMAP évoque quant à lui des risques quantitatifs sur l’emploi. « L’intelligence artificielle, les robots et l’automatisation pourraient créer un avenir caractérisé par un taux de chômage structurel élevé et ils ont déjà des effets sur une grande partie des travailleur…. Les coûts d’ajustement (aux mutations technologiques) sont importants. Ils peuvent avoir des conséquences négatives persistantes pour certains, voire à terme empêcher les perdants de tirer un bénéfice de ces évolutions, même après une longue période ». Qu’il s’agisse des services, du transport ou de la mobilité, du secteur financier ou des architectes, des économies gigantesques sont désormais possibles sur les salaires, facteur déterminant dans les coûts, notamment lorsqu’il s’agit d’emplois hautement qualifiés.

L’effondrement possible de l’emploi concernera également le tertiaire très qualifié dont les expertises seront progressivement intégrées dans des systèmes d’intelligence artificielle. Dans la logique de rentabilisation des entreprises, la vocation de ces systèmes est de remplacer à moindre coût du travail humain très cher, qui n’est pas disponible 24h/24h et qui calcule lentement, même assisté de systèmes performants. Sans débat sur le fond, sans implication forte des Etats, le risque est à la fois de pertes d’emplois massives et de déqualification des emplois les plus qualifiés, ceux qui coutent le plus cher aux entreprises… Ce qui nous renvoie au premier thème de ce papier : le caractère très cohérent et très rentable de ces technologies.

III/ Une rupture avec le mythe d’une industrie du numérique économe en ressources

Les industries numériques sont dématérialisées, on peut obtenir des centaines de milliers de copies de livres, films, albums musicaux sans production apparente, stockage, transport, etc. On a ainsi longtemps cru que ces industries étaient « vertueuses » en matière climatique, que leur impact était limité et que, finalement, les « vertus environnementales » du tertiaire pourraient compenser au moins en partie les nuisances d’industries polluantes et dépassées. Mais il s’agit d’une illusion d’optique, d’une invisibilisation des coûts environnementaux du numérique et de ses différents avatars. Ainsi, un datacenter de taille moyenne génère de l’ordre de 10 000 tonnes de CO² par an pour le refroidissement de ses systèmes. Mais il a aussi besoin d’un générateur de secours et d’une cuve de plusieurs dizaines de tonnes de fioul en cas de panne du réseau électrique. Il a également besoin d’eau pour son refroidissement, entrant de plus en plus en conflit d’usage avec des besoins prioritaires (eau potable, irrigation). La question à se poser est la suivante : l’expansion permanente du numérique est-elle dans les moyens de la planète ? En vingt ans, la consommation électrique a doublé, générant un second effet d’optique :

La part des renouvelables dans la production électrique a augmenté mais dans la mesure où la production électrique a doublé, le volume d’énergies fossiles n’a cessé d’augmenter, qu’il s’agisse de pétrole, gaz ou charbon. L’IA est l’occasion de se pencher sur cet enjeu masqué par un double discours sur les vertus de l’immatériel et le mythe d’une transition énergétique qui n’a pas commencé et qui n’aura pas lieu. Dit autrement, les industries numériques elles aussi reposent sur une économie extractive. Il faut du pétrole, du gaz et du charbon pour alimenter le numérique et il en faut de plus en plus, ces technologies étant de plus en plus gourmandes en ressources .

IV/ Une rupture anthropologique dans le domaine cognitif ?

Il y a soixante ans, André Leroi-Gourhan montrait que nos lointains ancêtres n’avaient dans toute leur vie vu que quelques représentations gravées ou peintes dans des cavernes ou sites en plein air . Mais ces représentations étaient profondes, riches des mythes et de l’histoire de ceux qui les regardaient, elles ouvraient sur une profondeur de réflexions. Nous sommes aujourd’hui confrontés à une submersion d’images, dont certaines construites délibérément pour fausser le jugement. Nous sommes aussi confrontés à des systèmes capables d’analyser des milliers de documents et d’en proposer une synthèse qui peut surpasser des analyses humaines et rendre très difficile la détection de différences entre des travaux d’universitaires et des productions d’IA générative.

Couplée à la généralisation des réseaux sociaux, à la polarisation des points de vue générée par l’usage de l’IA dans les suggestions de lectures et suggestions de « pairs » (partageant des points de vue proches), aux deep fake évoqués précédemment, à l’accroissement exponentielle du temps d’exposition aux écrans dès le plus jeune âge, l’usage des IA génératives met l’humanité face à un risque existentiel que les majors du secteur masquent délibérément, occupés qu’ils sont à vendre leurs produits hautement rentables. Qu’en sera-t-il des capacités d’analyse autonome, de la capacité de jugement, de la capacité à anticiper des phénomènes de toute nature, y compris des risques majeurs (changement climatique par exemple) si les humains délèguent à des systèmes techniques la production de connaissances, l’invention, l’innovation, la contestation créative et créatrice des idées, principes, morales, philosophies, sciences du moment ?

Cet enjeu anthropologique est aujourd’hui presque absent des débats, en dehors de certains des premiers concepteurs des IA qui alertent sans effets à ce jour sur un danger à prendre en compte, anticiper, encadrer avec la plus grande rigueur.

Sur ces quatre points, l’urgence est au débat.

Philippe Nikonoff Bordeaux

Auteur de “climat, mégafeux, inégalités. Pourquoi nous n’anticipons plus?” L’harmattan novembre 2022

A lire également

Inconnu au bataillon

Obsolescence du capitalisme, immédiateté de la visée, rapport de force

Que nous disent les luttes…?